Hay una entrevista extraordinaria a Denzel Washington en la que le preguntan por qué, en la adaptación cinematográfica de Fences, era importante que el director fuera afroamericano. ¿Acaso no habría podido dirigirla igual de bien otro director? Washington responde sin confrontar: no es un tema de color de piel; es un tema de cultura. Para explicarlo recurre a una comparación reveladora. Steven Spielberg dirigió La lista de Schindler. Martin Scorsese dirigió Goodfellas. Spielberg podría haber dirigido Goodfellas. Scorsese probablemente habría hecho un gran trabajo con La lista de Schindler. Sin embargo, señala Washington, hay diferencias culturales. Lo que faltaría no es técnica, sino algo menos explícito.

Washington aterriza la idea con un ejemplo aún más revelador: señala que todos los afroamericanos, como él mismo, saben perfectamente lo que se siente cuando un peine caliente toca el cabello un domingo por la mañana. Saben cómo huele. Eso es una diferencia cultural. Más allá del cine, nos invita a pensar en quiénes somos y cómo pensamos.

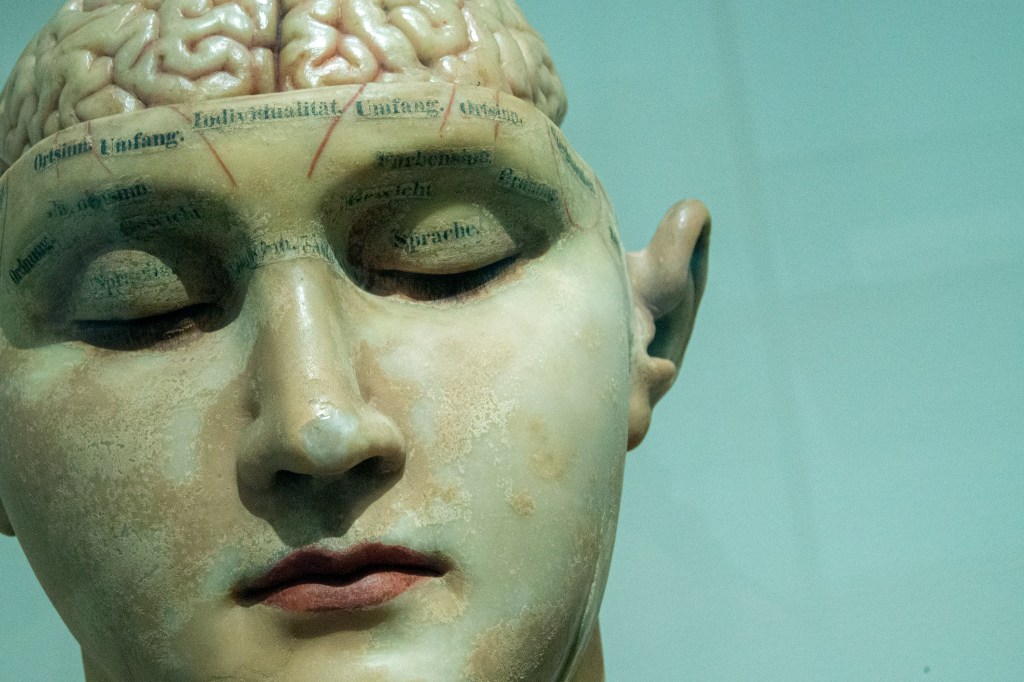

Los humanos nunca hemos pensado ni actuado únicamente desde el cerebro. Siempre hemos ampliado nuestra capacidad de pensar y actuar sobre el entorno. Pensamos y actuamos con herramientas. Construimos mundos que luego nos construyen. En biología, el fenotipo es el conjunto de rasgos observables de un organismo formados a partir de sus genes. Richard Dawkins mostró, sin embargo, que la acción de esos genes no termina en el cuerpo, sino que muchas veces modifica el entorno en el que vivimos. A eso lo llamó “fenotipo extendido”.

Si aceptamos la idea de que somos también nuestras extensiones, entonces entendemos que la inteligencia artificial no es una ruptura en la naturaleza de lo que somos, sino una aceleración radical de un proceso siempre en marcha. No es una ruptura ontológica. Amplía nuestro fenotipo en una dimensión particular: la de la información. Extiende nuestra mente externamente. Siguiendo a Annie Murphy Paul, pensar no es solo actividad cerebral, sino una práctica distribuida entre cuerpo, movimiento, personas, entorno y herramientas. La inteligencia artificial empieza a ocupar ese lugar como memoria externa y generador de alternativas.

Aquí, querido lector, aparece una primera tensión. Cuando la expansión es informacional, el riesgo no es físico. Tiene que ver con cómo sabemos lo que creemos saber y cómo distinguimos entre verdad y apariencia de verdad. Es un riesgo epistémico. Una inteligencia artificial que produce mucho también puede equivocarse mucho, pero al mismo tiempo crear una ilusión de veracidad. El problema ya no es la falta de información, sino la dificultad de discriminar lo verdadero de lo verosímil.

El contraste puede verse con nitidez si se compara cómo juzgan los humanos y cómo “juzgan” los modelos de lenguaje de la IA. Como lo han explicado a detalle Quattrociocchi y sus colaboradores, el juicio humano nace de la experiencia sensorial y social, se forma en contextos vividos, integra memoria, intuición, emociones y fines, se corrige a sí mismo y termina siendo sensible a valores. El juicio artificial, en cambio, opera sobre texto, detecta patrones estadísticos, integra contexto lingüístico y produce respuestas plausibles sin evaluar causas ni razones. No es conocimiento en sentido estricto, sino plausibilidad muy bien formada. El riesgo no es el error, sino la apariencia de comprensión, y la seguridad en proferir respuestas convincentes, allí donde falta experiencia.

En este sentido, los humanos no razonamos primordialmente mediante probabilidades puras como lo hace la IA. Razonamos en posibilidades por medio de historias que nos orientan en contextos inciertos y, sobre esa base, tomamos decisiones. Angus Fletcher denomina a este conjunto de capacidades “inteligencia primal”: esa capacidad ancestral de imaginar futuros posibles, no de calcularlos sino de reconocer patrones narrativos, no solo estadísticos.

Por lo tanto, la cultura no es un adorno del pensamiento: es su soporte de origen. No solo sabemos cosas, sabemos por qué son importantes. Y ese saber vive en prácticas compartidas, no solo en conceptos explícitos. En cambio, los modelos de lenguaje de gran escala no habitan ese ecosistema. No participan de una cultura. Pueden describir con precisión técnica cómo funciona un peine caliente, incluso explicar la química de la queratina capilar, pero no saben lo que significa esperarlo un domingo por la mañana. Operan en el espacio de las probabilidades y pueden generar historias verosímiles sobre una cultura sin haber vivido en ella.

Así, la inteligencia artificial no sustituye la comprensión humana. La IA funciona, más bien, como una extensión de la mente, una herramienta cognitiva que amplifica la memoria y la combinación, tal como la escritura o el cálculo ampliaron en su momento nuestro fenotipo mental. Expande el espacio de lo posible.

En resumidas cuentas, la IA puede explorar posibilidades, pero no debemos olvidar que el juicio siempre es nuestro. La IA puede dominar probabilidades, pero no sabe por qué el ajo debe cortarse tan fino que se disuelva en el aceite, ni cómo suena el tono exacto del canto del Shabbat justo después de encender las velas, y menos aún cómo huele un peine caliente un domingo por la mañana.